Quand’è stata l’ultima volta che hai avuto una “conversazione” con Siri o Alexa che si possa dire soddisfacente? Forse mai. Il motivo principale è che mentre questi assistenti o robot sono migliorati molto, la loro capacità di conversazione è rimasta piuttosto limitata. Google però questa settimana ha fatto un annuncio sul suo blog presentando Meena: un “agente conversazionale che può parlare di… qualsiasi cosa”, proprio come un essere umano. Certo i colossi della tecnologia come Google e Facebook ci hanno abituati e forse anche troppo, alla loro infinita serie di annunci sugli impressionanti progressi nel campo dell’AI. Tuttavia, la presentazione del nuovo chatbot di Google ha catturato l’attenzione di molti addetti al settore, ma cos’ha di speciale Meena?

Che differenza c’è tra Chatbot e AI?

Facciamo prima un passo indietro: innanzitutto un Chatbot non è necessariamente un AI, ma un software progettato per simulare una conversazione con un essere umano, che riceve quindi degli input dagli utenti ed in base a questi restituisce loro una risposta pre-impostata. Ad oggi possiamo trovare svariati tipi di Chatbot, solo su Facebook se ne contano quasi 800.000 per la customer care delle aziende private o come supporto alla pubblica amministrazione. Un chatbot basato su algoritmi di AI invece è in grado di imparare dagli input che riceve, migliorando la propria “conoscenza” e garantendo un miglioramento continuo delle risposte.

Come sono i Chatbot attualmente nel mercato?

La maggior parte delle Big-Tech possiede una propria versione di chatbot: pensiamo per esempio a Siri di Apple, Google Assistant di Google, Alexa di Amazon o Cortana di Microsoft, ma quali sono le caratteristiche che accomunano tutti i chatbot attualmente in commercio?

- Dominio chiuso / Basato su regole: la maggior parte dei chatbot è di dominio chiuso, il che significa che funzionano solo all’interno di un circuito specifico.

- Non conversazionali: le interazioni dovrebbero apparire simili a quelle umane. Con gli attuali sistemi in circolazione non è affatto così.

- Non multigiro: la maggior parte dei chatbot non riesce a prendere in considerazione le interazioni multiple (in cui l’utente e il chatbot interagiscono tra loro, a turno). Questo ci porta nuovamente ad un’esperienza poco umana.

Google Meena è diverso

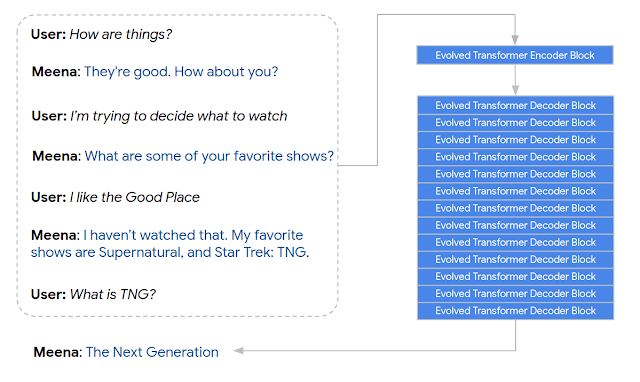

Arriviamo quindi a Meena: chatbot multigiro, a dominio aperto e alimentato da una rete neurale end-to-end, in grado di considerare più di 2,6 miliardi di parametri. Google afferma che può chattare con le persone meglio di qualsiasi generatore di intelligenza artificiale. Il team ha infatti “addestrato” il modello con 40 miliardi di parole: 341 GB di dati di testo, comprese le conversazioni sui social media, utilizzando il modello Seq2Seq, una variante di Transformer di Google, la rete neurale che confronta tra loro le parole in un paragrafo per capirne la correlazione. Meena possiede un blocco encoder ET e 13 blocchi decoder ET: mentre il prima aiuta a comprendere il contesto della conversazione, i decodificatori lo aiutano a formulare una risposta.

Sensibleness: la nuova metrica di conversazione

Il team di ricercatori ha anche ideato una nuova metrica per misurare quanto sia sensibile e specifica una conversazione o una risposta: la Sensibleness and Specificity Average (SSA). Un esempio? se dici “Mi piace il tennis” un chatbot probabilmente ti risponderà restando sul vago, qualcosa come: “è fantastico”, una risposta sicuramente sensata ma di certo non è specifica. Sono molti i chatbot che si basano su trucchi come questo per nascondere il fatto che non riconoscono ciò di cui si sta parlando. Meena invece potrebbe rispondere con qualcosa del tipo: “anch’io l’adoro, non ne ho mai abbastanza di Roger Federer”, una risposta decisamente più specifica.

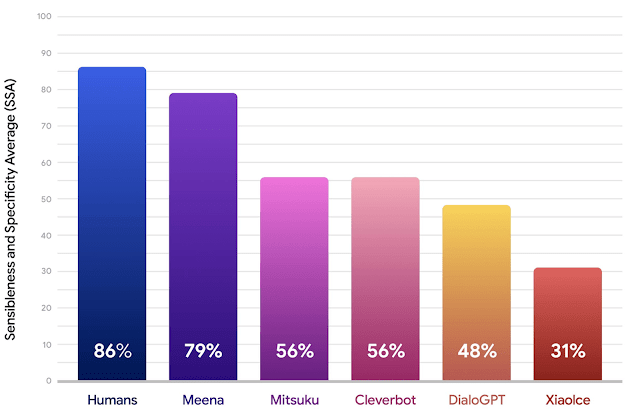

Google ha utilizzato i crowdworker per generare conversazioni di esempio e ottenere un punteggio in circa 100 conversazioni. Meena ha ottenuto un punteggio SSA del 79%, rispetto al 56% di Mitsuku, un chatbot all’avanguardia che ha vinto il premio Loebner negli ultimi quattro anni. Quindi, se perfino i partner di conversazione umana hanno segnato solo l’86% in questo nuovo test, è intuibile l’impatto innovativo che potrebbe avere Google Meena.

Quando potremo parlare con Meena?

Non prestissimo. Google ha affermato che non rilascerà una demo pubblica fino a quando non avrà verificato la sicurezza del modello sia in termini di privacy, sia in termini di “imparzialità” per evitare problemi come quelli incorsi da Microsoft, quando nel 2016 ha rilasciato il suo chatbot Tay su Twitter e questo ha iniziato a rilasciare invettive razziste e misogine in poche ore.

Perché Meena e i Chatbot sono così importanti?

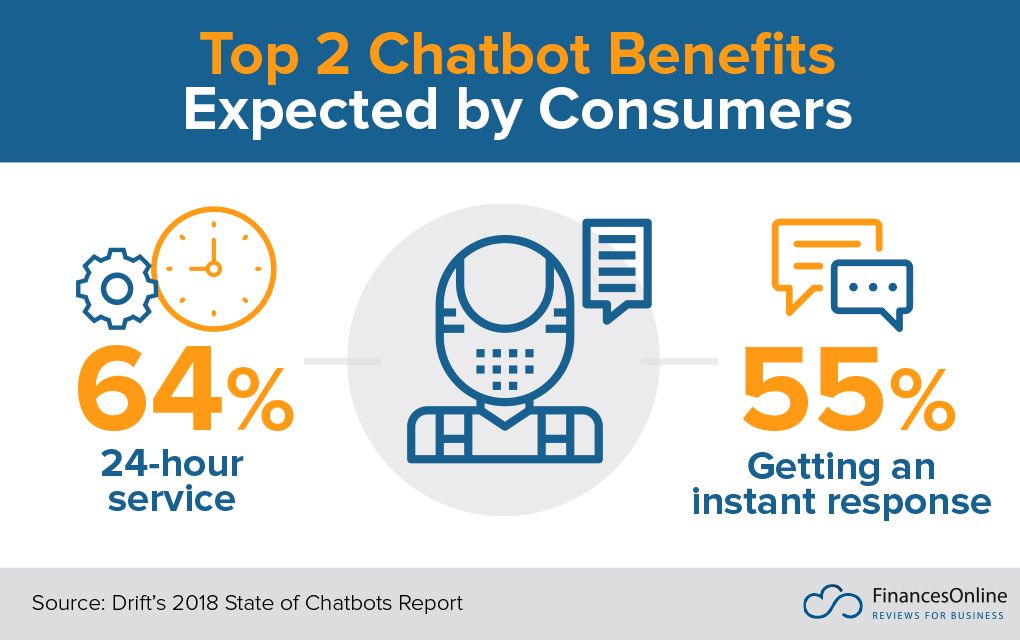

I chatbot sono vantaggiosi per il supporto clienti: da un lato questi vincono perché ottengono supporto 24 ore su 24, 7 giorni su 7, per le loro semplici domande, dall’altro le aziende vincono perché possono risparmiare sui costi del personale e consentire al personale di supporto di risolvere i problemi più difficili che i clienti devono affrontare. Qualche dato interessante:

- il 69% dei consumatori secondo Salesforce preferisce utilizzare i chatbot per la velocità con cui può comunicare con un marchio.

- I chatbot possono aiutare le aziende a risparmiare fino al 30% sui costi dell’assistenza clienti (IBM)

- Un sondaggio HubSpot ha trovato che il 47% dei consumatori sarebbe aperta a fare un acquisto da un chatbot (HubSpot)

- I negozi di e-commerce che adottano Facebook Messenger insieme a un chatbot di abbandono del carrello hanno iniziato a incrementare le entrate del 7-25% (Chatbots Magazine)

- Juniper Research stima che entro il 2023 i chatbot rappresenteranno $ 112 miliardi nelle vendite al dettaglio (Mobile Marketer)

I chatbot sono ancora uno spazio emergente in cui le grandi aziende come Google e Facebook, per citarne alcune, stanno concentrando parte dei loro investimenti. L’approccio e i risultati di Google per Meena sono entusiasmanti e mentre rimane ancora molto lavoro da fare per poter costruire chatbot validi per gli esseri umani in termini di competenza e versatilità, Meena sembra essere un passo nella giusta direzione.